일차 함수

- 함수

: y = f(x)

: 변수 x와 y가 있을 때, x가 변하면 이에 따라 y는 어떤 규칙으로 변하는지 나타냄

- 일차 함수

: y = ax + b (a ≠ 0)

: y가 x에 관한 일차식으로 표현되는 함수(x가 일차로 남으려면 a는 0이 아니어야 함)

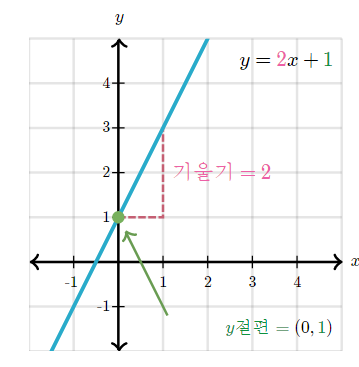

- 기울기

: y = ax + b

: x 값이 증가할 때 y 값이 어느 정도 증가하는지에 따라 그래프가 기울어진 정도

- y 절편

: y = ax + b

: 그래프가 y축과 만나는 지점

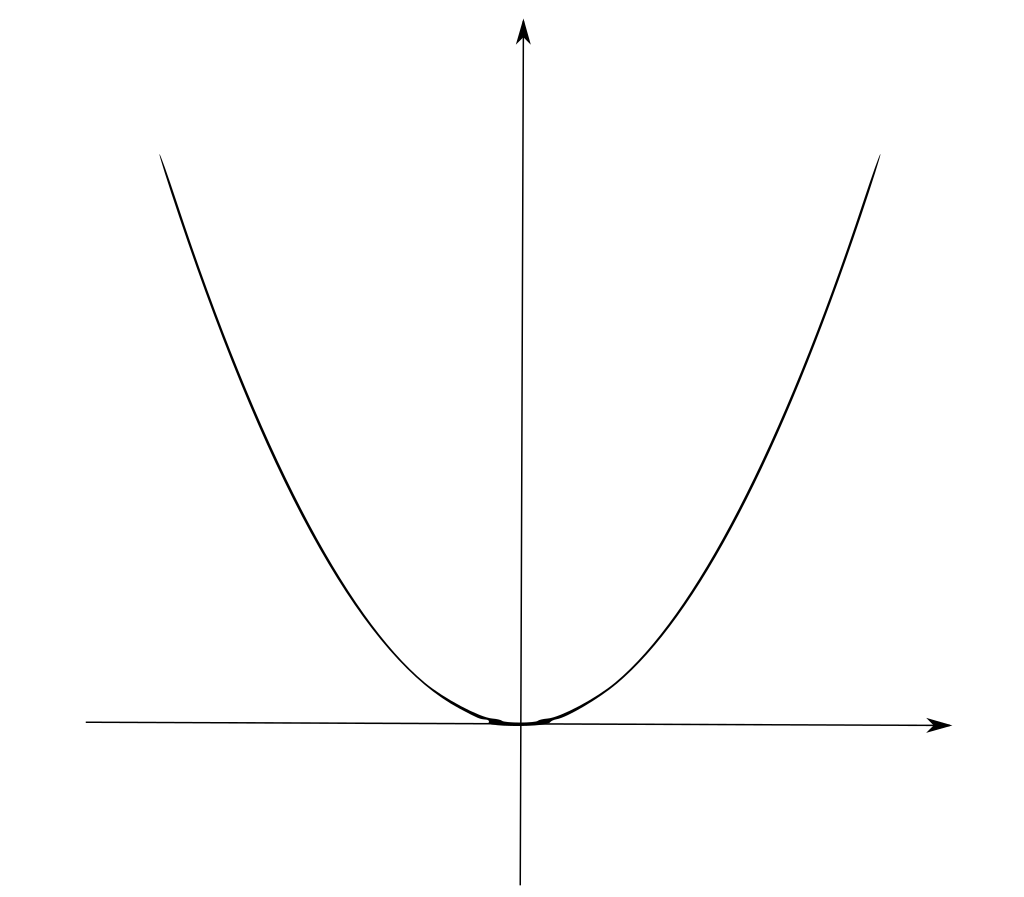

이차 함수

- 이차 함수

: y = ax^2 (a ≠ 0)

: y가 x에 관한 이차식으로 표현되는 함수

- 최솟값

: y = a(x-p)^2 + q에서 (p, q)

: 포물선의 맨 아래에 위치한 지점

: 최소 제곱법 공식으로 쉽게 알아낼 수 있음

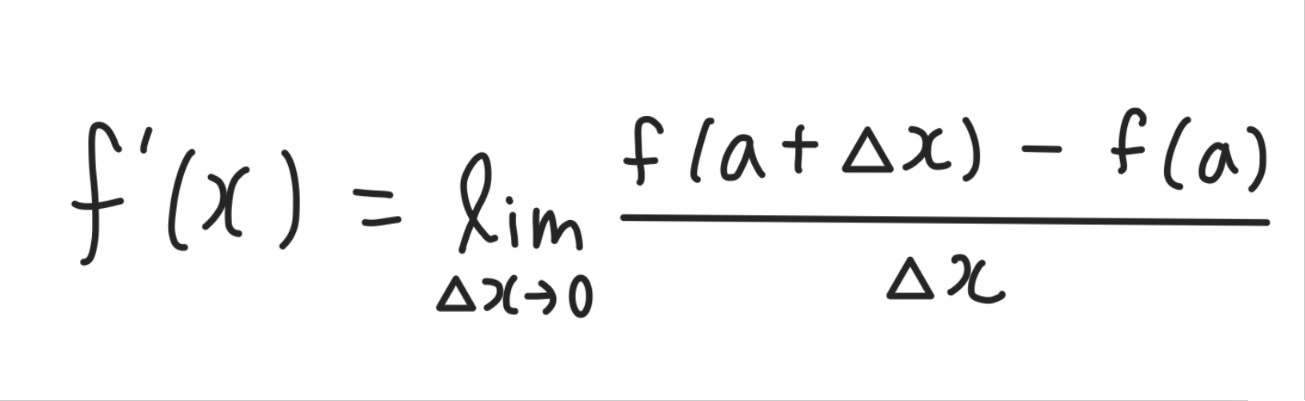

미분

- 순간 변화율(미분 계수)

: 어느 한 점에서의 접선의 기울기

: 미분 계수가 0일 때, 그래프의 최솟값

- 미분의 기본 공식

① f(x) = x일 때, f'(x) = 1

② f(x) = a에서 a가 상수일 때, f'(x) = 0

③ f(x) = ax에서 a가 상수일 때, f'(x) = a

④ f(x) = x^a에서 a가 자연수일 때, f'(x) = ax^(a-1)

⑤ f(g(x))에서 f(x)와 g(x)가 미분 가능할 때 {f(g(x))}' = f'(g(x)) * g'(x)

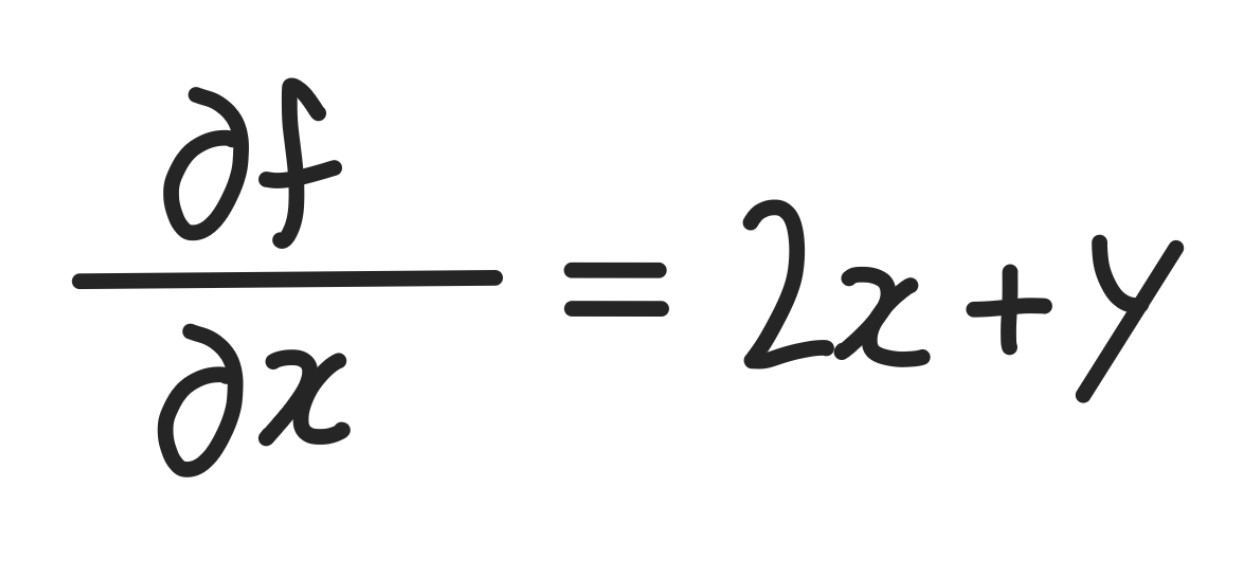

편미분

- 편미분

: 한 가지 변수만 미분하고 그 외에는 모두 상수로 취급

지수 함수

- 밑과 지수

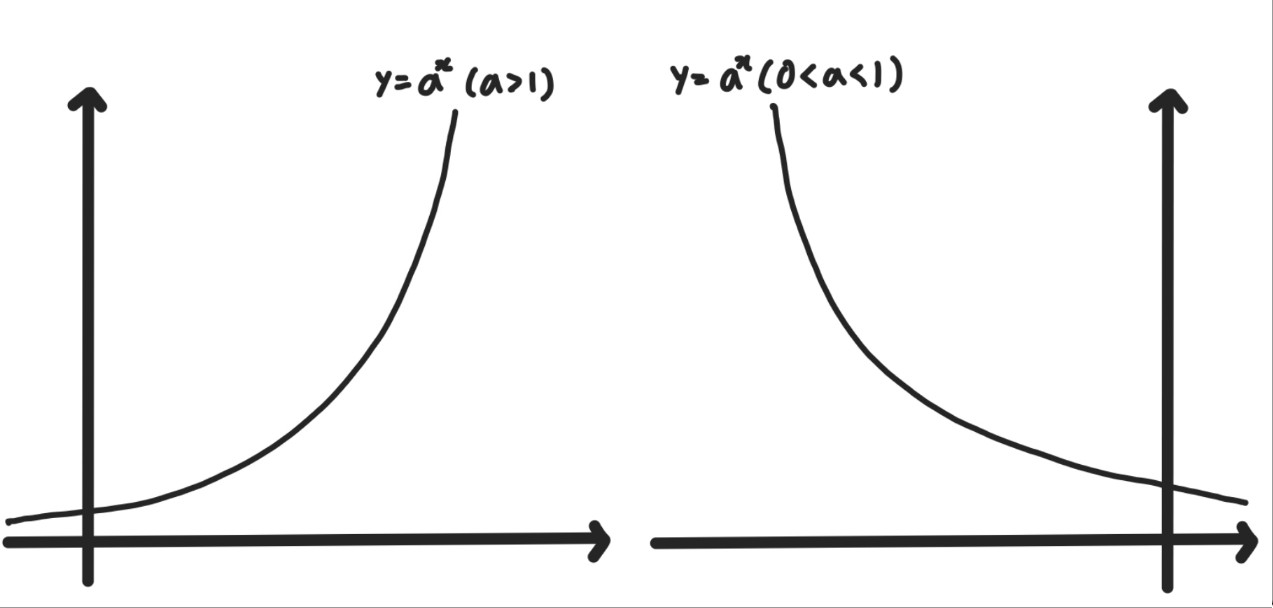

- 지수 함수

: y = a^x (a ≠ 1, a > 0)

: 변수 x가 지수 자리에 있는 함수(밑이 1이면 함수가 아니고 0이면 허수 포함하므로 제외)

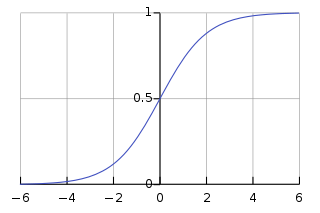

시그모이드 함수

- 지수 함수에서 밑 값이 자연 상수 e인 함수

- x가 큰 값을 가지면 f(x)는 1에 가까워지고, x가 작은 값을 가지면 f(x)는 0에 가까워짐

로그 함수

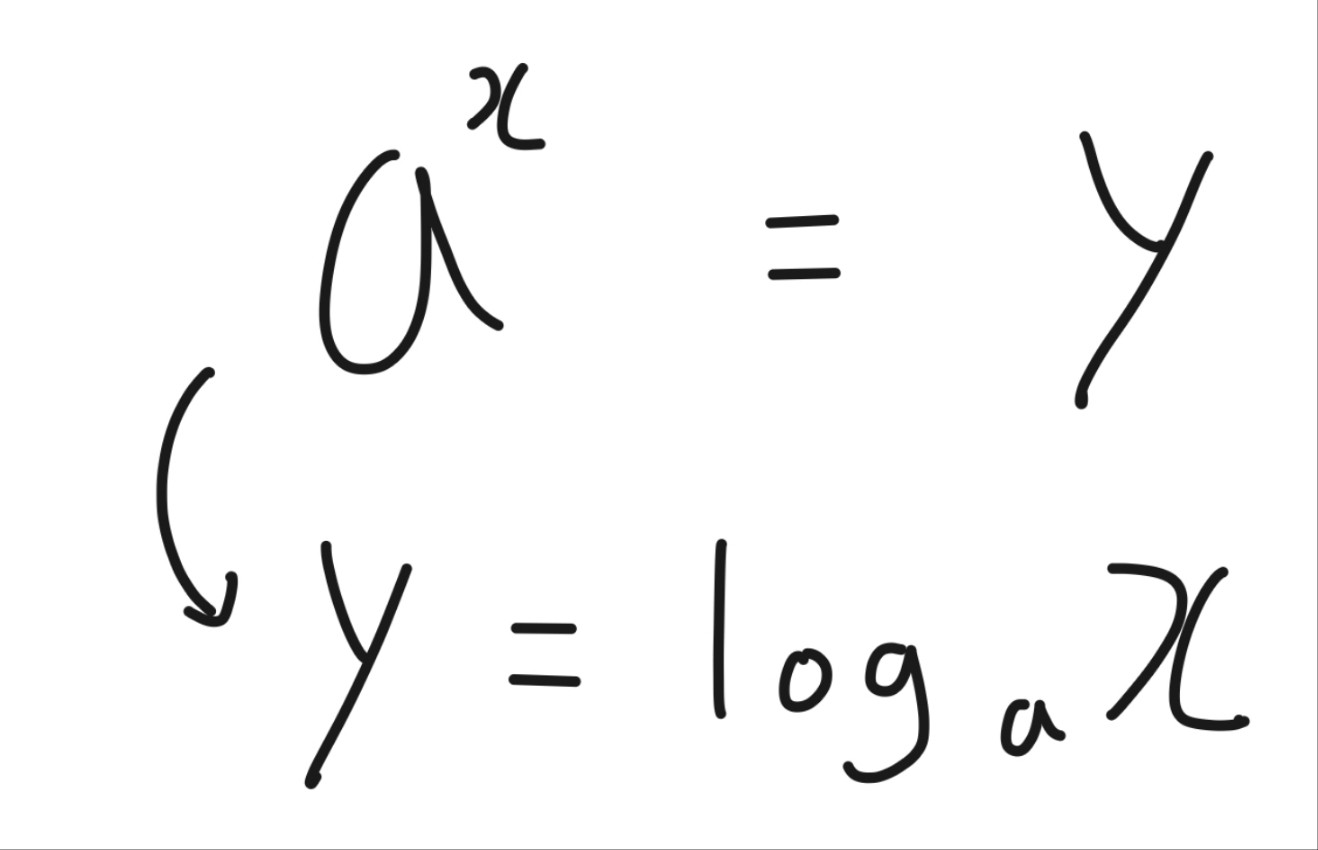

- 로그

: 지수 함수에서 지수 x의 값을 구하기 위해 사용

- 로그 함수

: 지수 함수와 역함수 관계

: 지수 함수 y = a^x의 그래프를 y = x에 대칭하여 이동

- 로지스틱 회귀에서 사용하는 함수

'모두의 딥러닝 개정 3판'의 내용과 https://github.com/taehojo/deeplearning의 코드 참고

'AI > 모두의 딥러닝' 카테고리의 다른 글

| [모두의 딥러닝] 6. 다중 선형 회귀(multiple linear regression) (0) | 2023.05.18 |

|---|---|

| [모두의 딥러닝] 5. 경사 하강법(gradient decent) (0) | 2023.05.16 |

| [모두의 딥러닝] 4. 평균 제곱 오차(Mean Square Error, MSE) (0) | 2023.05.16 |

| [모두의 딥러닝] 3. 선형 회귀(linear regression), 최소 제곱법(method of least squares) (0) | 2023.05.15 |

| [모두의 딥러닝] 1. 폐암 수술 환자의 생존율 예측 코드 맛보기 (0) | 2023.05.12 |